【行业】AI芯片行业研究报告(52页)

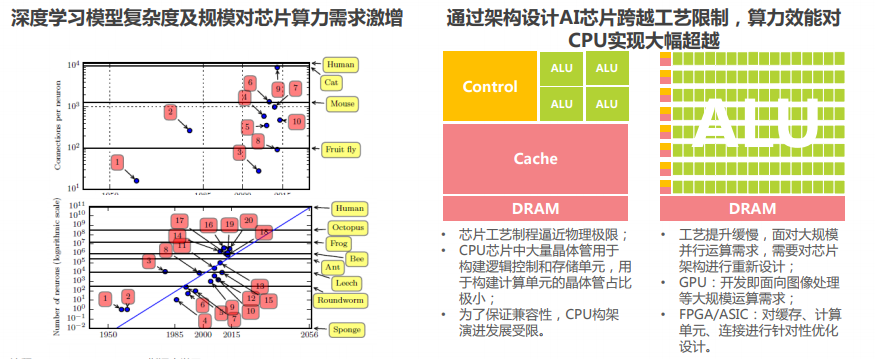

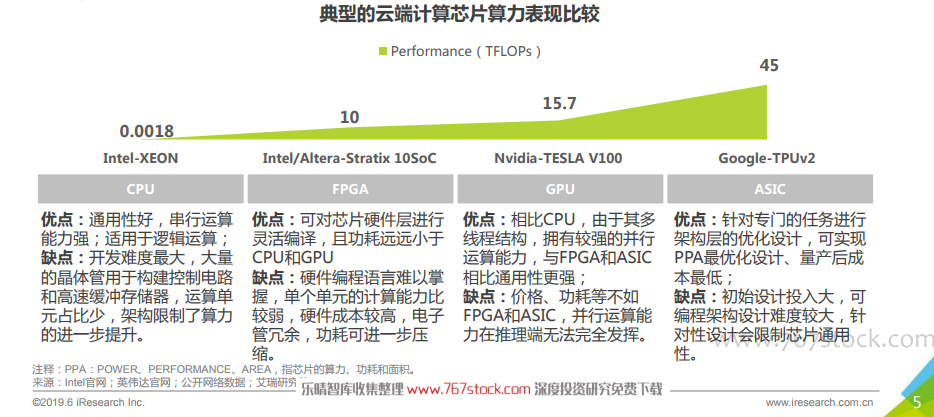

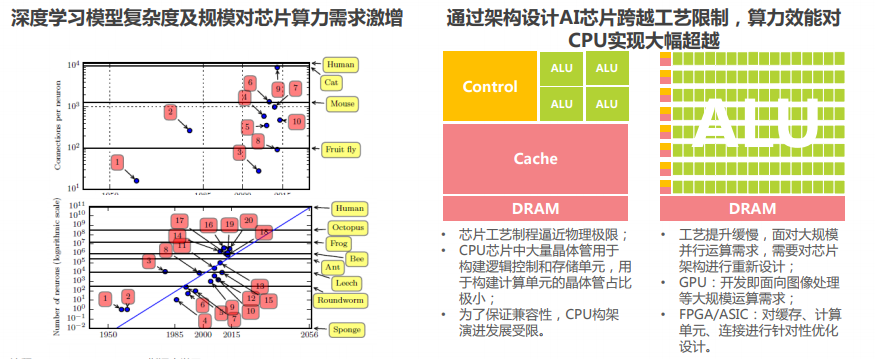

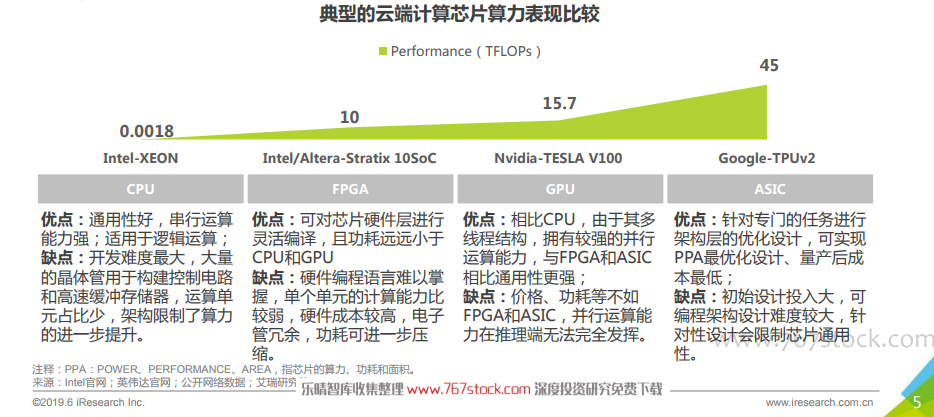

AI芯片:基于矩阵运算、面向AI应用的芯片设计方案。1、定义:当前AI芯片设计方案繁多,包括但不限于GPU\FPGA\ASIC\DSP等。目前市场上的对于AI芯片并无明确统一的定义,广义上所有面向人工智能(Artificial Intelligence,AI)应用的芯片都可以被称为AI芯片。2、当前AI运算指以“深度学习” 为代表的神经网络算法,需要系统能够高效处理大量非结构化数据(文本、视频、图像、语音等)。这需要硬件具有高效的线性代数运算能力,计算任务具有:单位计算任务简单,逻辑控制难度要求低,但并行运算量大、参数多的特点。对于芯片的多核并行运算、片上存储、带宽、低延时的访存等提出了较高的需求。3、针对不同应用场景,AI芯片还应满足:对主流AI算法框架兼容、可编程、可拓展、低功耗、体积及造价等需求。 AI芯片满足AI应用所需的“暴力计算”需求。早在上世纪80年代,学术界已经提出了相当完善的人工智能算法模型,但直到近些年,模型的内在价值也没有被真正的实现过。这主要是受限于硬件技术发展水平,难以提供可以支撑深度神经网络训练/推断过程所需要的算力。直到近年来GPU\FPGA\ASIC等异构计算芯片被投入应用到AI应用相关领域,解决了算力不足的问题。下图以云计算场景为例,通过对全球几大科技巨头的代表性云端芯片产品计算性能对比,我们可以发现ASIC芯片相比起其他几种芯片,在计算效能、大小、成本等方面都有着极大优势,未来随着通用AI指令集架构的开发,预计会出现最优配置的AI计算芯片。

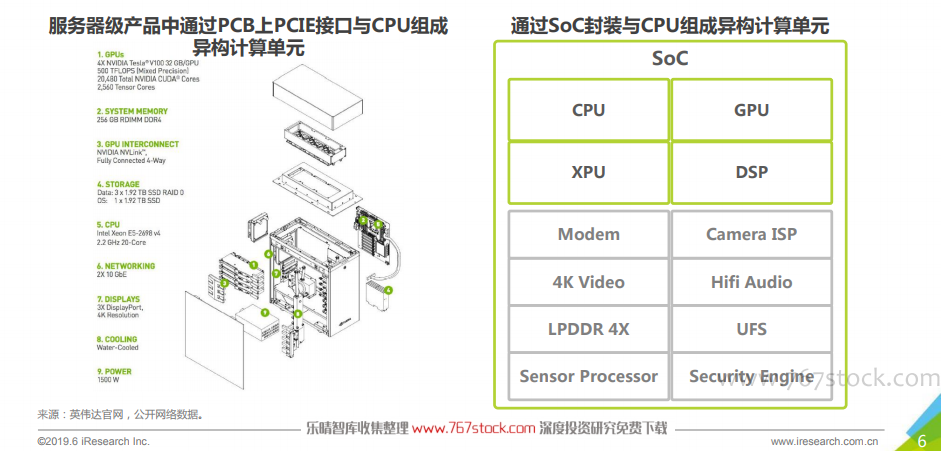

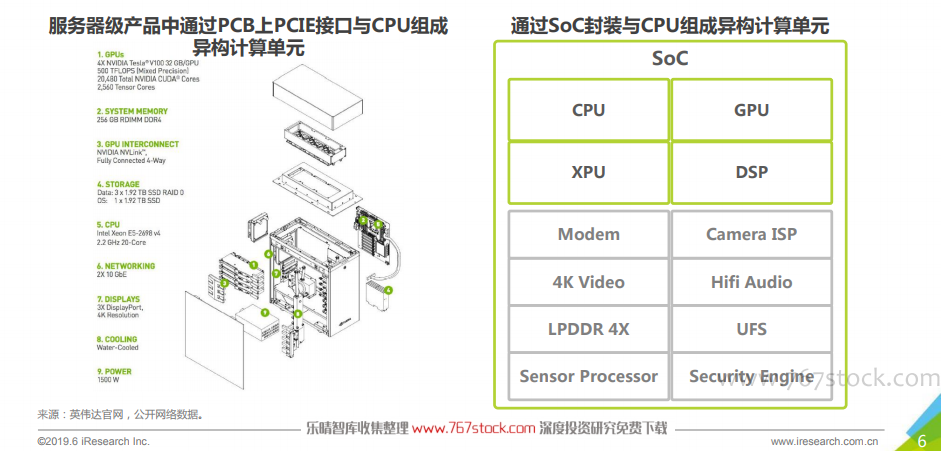

AI芯片满足AI应用所需的“暴力计算”需求。早在上世纪80年代,学术界已经提出了相当完善的人工智能算法模型,但直到近些年,模型的内在价值也没有被真正的实现过。这主要是受限于硬件技术发展水平,难以提供可以支撑深度神经网络训练/推断过程所需要的算力。直到近年来GPU\FPGA\ASIC等异构计算芯片被投入应用到AI应用相关领域,解决了算力不足的问题。下图以云计算场景为例,通过对全球几大科技巨头的代表性云端芯片产品计算性能对比,我们可以发现ASIC芯片相比起其他几种芯片,在计算效能、大小、成本等方面都有着极大优势,未来随着通用AI指令集架构的开发,预计会出现最优配置的AI计算芯片。 AI芯片对CPU并非替代,与CPU共同满足新时代计算需求。目前来看,AI芯片并不能取代CPU的位置,正如GPU作为专用图像处理器与CPU的共生关系,AI芯片将会作为CPU的AI运算协处理器,专门处理AI应用所需要的大并行矩阵计算需求,而CPU作为核心逻辑处理器,统一进行任务调度。在服务器产品中,AI芯片被设计成计算板卡,通过主板上的PCIE接口与CPU相连;而在终端设备中,由于面积、功耗成本等条件限制,AI芯片需要以IP形式被整合进SoC系统级芯片,主要实现终端对计算力要求较低的AI推断任务。

AI芯片对CPU并非替代,与CPU共同满足新时代计算需求。目前来看,AI芯片并不能取代CPU的位置,正如GPU作为专用图像处理器与CPU的共生关系,AI芯片将会作为CPU的AI运算协处理器,专门处理AI应用所需要的大并行矩阵计算需求,而CPU作为核心逻辑处理器,统一进行任务调度。在服务器产品中,AI芯片被设计成计算板卡,通过主板上的PCIE接口与CPU相连;而在终端设备中,由于面积、功耗成本等条件限制,AI芯片需要以IP形式被整合进SoC系统级芯片,主要实现终端对计算力要求较低的AI推断任务。

AI芯片满足AI应用所需的“暴力计算”需求。早在上世纪80年代,学术界已经提出了相当完善的人工智能算法模型,但直到近些年,模型的内在价值也没有被真正的实现过。这主要是受限于硬件技术发展水平,难以提供可以支撑深度神经网络训练/推断过程所需要的算力。直到近年来GPU\FPGA\ASIC等异构计算芯片被投入应用到AI应用相关领域,解决了算力不足的问题。下图以云计算场景为例,通过对全球几大科技巨头的代表性云端芯片产品计算性能对比,我们可以发现ASIC芯片相比起其他几种芯片,在计算效能、大小、成本等方面都有着极大优势,未来随着通用AI指令集架构的开发,预计会出现最优配置的AI计算芯片。

AI芯片满足AI应用所需的“暴力计算”需求。早在上世纪80年代,学术界已经提出了相当完善的人工智能算法模型,但直到近些年,模型的内在价值也没有被真正的实现过。这主要是受限于硬件技术发展水平,难以提供可以支撑深度神经网络训练/推断过程所需要的算力。直到近年来GPU\FPGA\ASIC等异构计算芯片被投入应用到AI应用相关领域,解决了算力不足的问题。下图以云计算场景为例,通过对全球几大科技巨头的代表性云端芯片产品计算性能对比,我们可以发现ASIC芯片相比起其他几种芯片,在计算效能、大小、成本等方面都有着极大优势,未来随着通用AI指令集架构的开发,预计会出现最优配置的AI计算芯片。 AI芯片对CPU并非替代,与CPU共同满足新时代计算需求。目前来看,AI芯片并不能取代CPU的位置,正如GPU作为专用图像处理器与CPU的共生关系,AI芯片将会作为CPU的AI运算协处理器,专门处理AI应用所需要的大并行矩阵计算需求,而CPU作为核心逻辑处理器,统一进行任务调度。在服务器产品中,AI芯片被设计成计算板卡,通过主板上的PCIE接口与CPU相连;而在终端设备中,由于面积、功耗成本等条件限制,AI芯片需要以IP形式被整合进SoC系统级芯片,主要实现终端对计算力要求较低的AI推断任务。

AI芯片对CPU并非替代,与CPU共同满足新时代计算需求。目前来看,AI芯片并不能取代CPU的位置,正如GPU作为专用图像处理器与CPU的共生关系,AI芯片将会作为CPU的AI运算协处理器,专门处理AI应用所需要的大并行矩阵计算需求,而CPU作为核心逻辑处理器,统一进行任务调度。在服务器产品中,AI芯片被设计成计算板卡,通过主板上的PCIE接口与CPU相连;而在终端设备中,由于面积、功耗成本等条件限制,AI芯片需要以IP形式被整合进SoC系统级芯片,主要实现终端对计算力要求较低的AI推断任务。